[기술] AI 기업 인프라 경쟁 가속화,

게임 AI 에이전트 발전의 새로운 동력

글로벌 게임산업 동향

집필: EC21R&C 김형석 책임연구원

Executive Summary

AI 인프라 경쟁 가속화와 대규모 공급 계약 체결

GPT-4, Claude 3, Gemini 등 수천억 파라미터 모델 등장으로 전례 없는 컴퓨팅 자원 수요 발생

Nvidia-OpenAI 10GW(최대 약 147.3조 원), Broadcom-OpenAI 맞춤형 ASIC 10GW 등 대규모 계약 체결

AMD-OpenAI 6GW 공급 및 약 10% 지분 워런트 발행, 멀티 벤더 전략을 통한 공급망 다각화 추진

HBM 메모리 공급망 제약(SK하이닉스·Samsung·Micron)과 에너지 인프라 확보가 핵심 과제로 부상

게임 AI 에이전트 기술 발전과 AI 칩 시장 경쟁 심화

Nvidia ACE 플랫폼 공개, 2025년 CES에서 〈배틀그라운드〉, 〈인조이〉 등 AI NPC 데모 선보여

Inworld AI, Convai, Charisma.ai 등 AI NPC 플랫폼 경쟁 구도 형성, Ubisoft NEO NPC 프로젝트 진행

Nvidia 시장 점유율 65% 이상 독주 속 AMD MI300X 30만 개 이상 판매, 가격 경쟁력으로 추격

Google Ironwood TPU 슈퍼포드 42.5 엑사플롭스 성능 제공, Anthropic Claude 모델 훈련에 활용

한국 게임산업의 시사점과 대응 방안

대형 게임사의 AI 칩 공급망 다변화 전략 검토, 클라우드 기반 AI 서비스 활용 방안 모색 필요

중소 게임 개발사는 Inworld AI, Convai 등 서비스형 플랫폼 활용으로 초기 도입 비용 절감 가능

AI NPC의 개인정보 수집, 편향된 발언, 어린이·청소년 영향 등 윤리적 문제 대응 가이드라인 수립 필요

2026~2027년 AAA 게임 AI NPC 본격 도입 전망, 선제적 기술·인력 확보와 가드레일 시스템 구축 권고

1. AI 인프라 경쟁의 배경과 주요 공급 계약

대형 AI 모델 개발 경쟁으로 수십 기가와트 규모 인프라 확보 경쟁 본격화

대형언어모델(LLM)과 멀티모달 모델의 급격한 발전은 전례 없는 규모의 컴퓨팅 자원을 요구하고 있다. GPT-5, Claude 4.5, Gemini 3 등 수천억 개의 파라미터를 사용하는 모델이 등장하면서, 연구기관과 기업은 막대한 인프라 투자 없이는 경쟁에서 뒤처질 수밖에 없는 상황에 직면했다. 이에 따라 OpenAI, Anthropic, Google, Meta 등 AI 기업들은 안정적인 연산 자원 확보를 위해 장기 공급 계약을 경쟁적으로 체결하고 있다. 이러한 AI 인프라 경쟁은 단순히 GPU를 구매하는 수준을 넘어 지분 참여, 맞춤형 칩 설계, 전력 인프라 확보 등 전략적 요소를 포함하는 복합적인 경주로 확대되었다.

2025년 9월, OpenAI와 Nvidia는 최소 10GW 규모의 AI 인프라 공급 계약에 합의했다. Nvidia는 OpenAI에 비의결권 주식을 취득하고 최대 1,000억 달러(약 147.3조 원)를 투자할 계획이며, 공급은 2026년 하반기부터 Vera Rubin 플랫폼을 기반으로 시작된다. 아울러 2025년 10월에는 Broadcom과 OpenAI가 10GW 규모의 맞춤형 AI 가속기(ASIC) 개발 계약을 발표했다. 양사는 2026년부터 랙 단위로 배치를 시작해 2029년까지 10GW를 완성할 계획이다. Broadcom의 ASIC은 OpenAI 모델에 특화된 설계로 메모리 아키텍처와 연산 유닛을 모델 패턴에 맞게 최적화할 수 있어 계산 비용을 크게 절감할 것으로 기대된다.

<표> 주요 AI 기업의 인프라 공급 계약 현황

AMD-OpenAI 6GW 공급 계약 및 지분 제휴, 공급망 다각화 전략 가속화

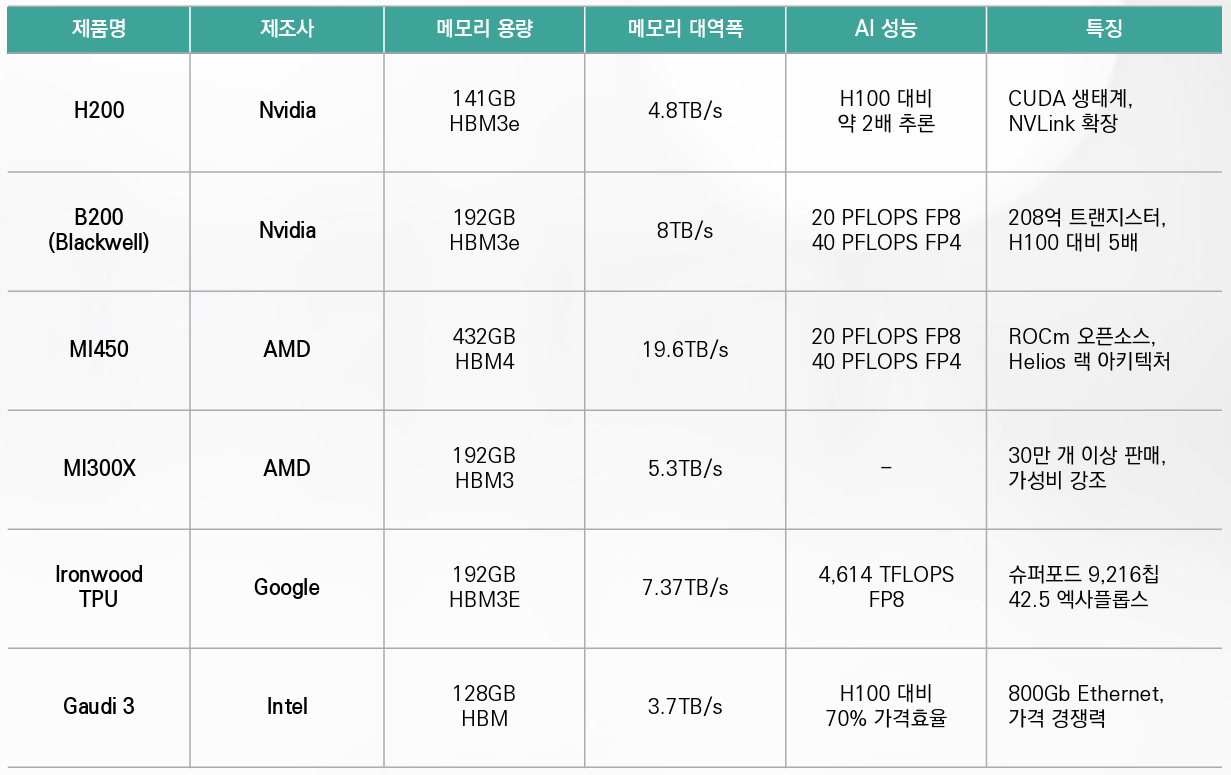

2025년 10월 6일, AMD와 OpenAI는 6기가와트 규모의 공급 계약을 체결했다. AMD는 Instinct MI450 GPU 기반 시스템을 제공하고, OpenAI는 AMD 지분 1억 6,000만 주(약 10%)를 0.01달러(15원)에 매입할 수 있는 워런트를 확보했다. MI450 기반 1GW는 2026년 하반기부터 배치될 예정이며, 계약 규모는 수십억 달러(약 1.5조~14.6조 원)로 추정된다. MI450는 432GB HBM4 메모리와 19.6TB/s 대역폭을 제공하며, FP4 40PFLOPS 성능을 갖추고 있다. 이는 Nvidia H200(141GB)보다 월등히 큰 메모리 용량으로, LLM 추론에서 높은 효율을 제공할 것으로 기대된다. Oracle은 2026년 하반기 5만 개 MI450를 배치해 AI 슈퍼클러스터를 구축할 계획이다.

AI 기업들이 멀티 벤더 전략을 채택하는 배경에는 Nvidia의 독점적 지위 견제와 가격 협상력 확보라는 목적이 있다. Nvidia는 2023년 기준 데이터센터 AI 칩 시장에서 65% 이상의 점유율을 차지하고 있으며, 일부 분석에서는 2024년 92%에 달한다고 추정한다. 또한 HBM 메모리 공급망이 SK하이닉스, Samsung, Micron 등 제한된 제조사에 의존하고 있어 공급 병목 현상이 발생할 수 있다. 아울러 6GW 규모의 계약은 원자력 발전소 수준의 전력을 요구하므로, 데이터센터 냉각과 전력효율 향상이 필수적이다. 이에 따라 인프라 계약에는 장기 메모리 공급 계약과 전력 구매 협약(PPA)이 포함되는 경우가 많다.

<표> 주요 AI 칩 제품 사양 비교

2. 게임 AI 에이전트 기술의 발전과 적용 사례

Nvidia ACE 플랫폼 공개로 게임 AI NPC 기술의 본격적 발전 시작

게임업계는 AI NPC(Non-Playable Character)에 생성형 AI를 적용해 플레이어와 자연스러운 상호작용을 구현하려는 시도를 본격화하고 있다. 2023년 Nvidia가 발표한 ACE(Avatar Cloud Engine)는 게임 속 NPC가 플레이어와 실시간으로 대화하고 감정 표현을 할 수 있도록 지원하는 플랫폼이다. ACE는 세 가지 핵심 모듈로 구성된다. NeMo는 언어 모델 커스터마이징을 지원해 게임 개발사가 NPC 대사를 학습시킬 수 있고, Riva는 음성 인식과 합성을 수행하며, Audio2Face는 음성 입력을 얼굴 애니메이션으로 변환한다. 해당 모듈들은 GPU와 분산 서버에서 실행되어 지연을 최소화하며, 개발자는 ACE for Games SDK를 통해 직접 서버를 구축하거나 GeForce Now를 활용할 수 있다.

2025년 CES에서 Nvidia는 〈배틀그라운드(PUBG: Battlegrounds)〉, 〈나라카: 블레이드포인트(Naraka: Bladepoint)〉, 〈인조이(inZOI)〉 등 다양한 게임에 ACE를 도입한다고 발표했다. 해당 데모에서 AI NPC는 게임 슬랭을 이해하고 플레이어와 협력하여 전투, 운전, 탐험을 수행하는 모습을 보여주었다. 특히 AI 동료는 플레이어의 전략에 따라 행동을 조정하고, 플레이어의 발화를 자연스럽게 이해할 수 있었다. 아울러 Nvidia는 Convai와 협력해 100ms 이하의 지연으로 대화를 생성하는 데 성공했다. 그러나 ACE는 하드웨어 요구 스펙이 높고 가격이 비싸며, 대규모 게임에서는 여전히 수백 대의 H100/H200 GPU가 필요할 것으로 예상된다.

<표> Nvidia ACE 플랫폼 구성 모듈 및 기능

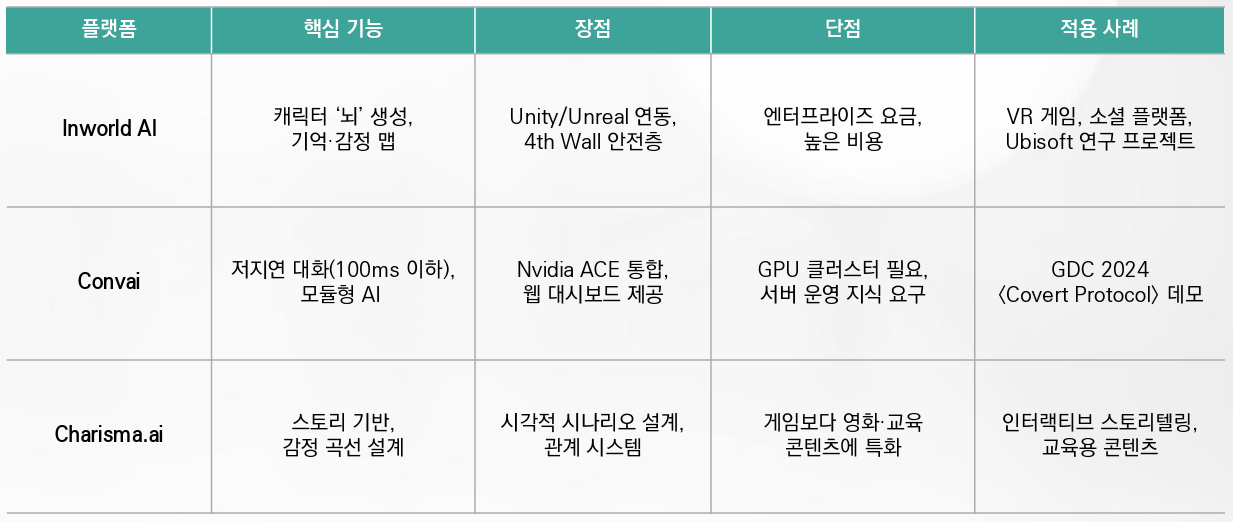

Inworld AI, Convai, Charisma.ai 등 AI NPC 플랫폼 경쟁 구도 형성

Nvidia ACE 외에도 다양한 스타트업과 플랫폼이 게임 AI NPC 개발 도구를 제공하며 경쟁 구도를 형성하고 있다. Inworld AI는 게임 개발자가 캐릭터의 성격, 목표, 배경을 기술하면 NPC의 인지 모델을 생성하는 플랫폼이다. NPC는 기억과 감정 맵을 통해 이전 대화를 기억하고 트리거에 따라 감정이 변화한다. Unity, Unreal, Niantic 8th Wall 등 주요 게임·AR 엔진과 공식 연동되어 있으며, AI 모델의 응답을 검열하는 ‘4th Wall’ 안전층을 제공해 부적절한 발언을 차단한다. 다만 엔터프라이즈 요금제를 적용해 중소 개발사에게는 비용 장벽이 있다. Convai는 Nvidia ACE와 협력하여 100ms 이하의 저지연 대화를 제공하며, GDC 2024에서 공개된 〈Covert Protocol〉 데모에서 NPC가 고유의 목표와 행동 패턴을 갖고 스토리가 분기되는 경험을 보여주었다.

Ubisoft는 2024년 NEO NPC 프로젝트를 통해 AI NPC의 가능성과 한계를 실험했다. 연구팀은 Nvidia Audio2Face와 Inworld AI를 결합해 NPC가 플레이어와 자연스러운 대화를 할 수 있게 했으며, 작가들은 캐릭터의 역사와 성격을 정의하고 AI 모델이 그 가이드라인 내에서 자율적으로 대사를 생성하도록 프롬프트를 설계했다. 해당 프로젝트는 인간 창의성과 AI 자동화의 균형을 강조하며, AI가 예측할 수 없는 발언을 하지 않도록 가드레일을 적용하고 작가가 모델의 톤과 응답을 직접 조정했다. 또한 윤리적·문화적 고려를 포함한 검열 시스템을 통해 AI NPC가 플레이어 경험을 해치지 않도록 관리했다. 이러한 사례는 AAA 게임업계가 AI NPC 도입을 진지하게 검토하고 있음을 보여준다.

<표> 주요 AI NPC 플랫폼 비교

Nvidia 독주 체제 속 AMD·Google TPU의 추격 가속화

Nvidia는 AI 데이터센터 시장에서 절대적인 우위를 점하고 있다. TechInsights 자료에 따르면 2023년 기준 Nvidia의 시장 점유율은 65% 이상이며, 일부 분석에서는 2024년 92%에 달한다고 추정한다. Nvidia의 성공 요인은 CUDA 소프트웨어 생태계와 NVLink 기반 확장성이다. 반면 AMD는 MI300X를 통해 Meta, Microsoft, Oracle 등에 30만 개 이상을 판매하며 가격 대비 성능을 강조하고 있다. Google도 자체 TPU로 AI 가속기 시장에서 경쟁하고 있다. 2025년 4월 발표된 Ironwood TPU는 4,614 TFLOPS FP8 성능과 192GB HBM3E 메모리, 7.37TB/s 대역폭을 제공한다. 특히 9,216개 칩으로 구성된 슈퍼포드는 42.5 엑사플롭스의 연산력과 1.77PB 메모리를 제공하며, 이는 Nvidia NVL72 슈퍼클러스터(0.36 엑사플롭스)와 비교해 약 118배에 달하는 규모다.

Anthropic은 2024년 이후 Google Cloud와 협력하여 TPU를 기반으로 Claude 모델을 훈련하고 있다. Ironwood TPU는 이전 세대인 Trillium 대비 10배 성능과 4배 에너지 효율 개선을 이뤘다. 다만 TPU는 XLA 컴파일러 기반 소프트웨어 스택에 의존해 CUDA 생태계와 상호운용성이 부족하고, Google Cloud 전용 서비스로 제공되어 접근성이 제한적이다. 이 때문에 개발자들이 기존 코드와 훈련 파이프라인을 크게 수정해야 하는 부담이 있어 광범위한 산업 채택에는 시간이 필요하다. 게임에서 실시간 AI NPC를 구현하려면 대규모 GPU/TPU 클러스터가 필수적이다. 전문가들은 2026~2027년경 AAA 게임에서 AI NPC가 본격 도입될 것으로 전망하며, 초기에는 제한된 수의 NPC로 시작해 인프라 확장에 따라 모든 NPC가 AI를 갖춘 게임이 등장할 것으로 예상하고 있다.

3. 한국 게임산업의 AI 인프라 및 AI NPC 대응 방안

글로벌 AI 인프라 경쟁 가속화에 따른 한국 게임산업의 대응

글로벌 AI 기업들이 수십 기가와트 규모의 인프라 공급 계약을 체결하고 멀티 벤더 전략을 채택하는 가운데, 한국 게임산업도 이러한 변화에 선제적으로 대응할 필요가 있다. 대형 게임사의 경우 특정 클라우드 제공업체나 AI NPC 플랫폼에 종속되지 않도록 선택지를 다변화하는 전략이 필요하다. AWS, Google Cloud, Microsoft Azure 등 다양한 클라우드 AI 서비스를 비교 검토하고, Nvidia ACE 외에도 Inworld AI, Convai 등 복수의 AI NPC 플랫폼을 테스트함으로써 비용 협상력을 확보하고 기술 종속 리스크를 분산할 수 있다. 자체 GPU 클러스터를 구축하기보다는 클라우드 기반 AI 서비스를 활용하는 방안이 초기 투자 부담을 줄이는 데 효과적이며, 필요에 따라 유연하게 연산 자원을 확장하거나 축소할 수 있다.

중소 게임 개발사의 경우 Inworld AI, Convai 등 서비스형 AI NPC 플랫폼을 활용함으로써 초기 도입 비용을 절감할 수 있다. 이러한 플랫폼은 자체 GPU 클러스터 구축 없이도 AI NPC 기능을 게임에 통합할 수 있게 해주며, Unity나 Unreal 엔진과의 연동을 지원해 개발 편의성을 높인다. 다만 대규모 사용자 수를 처리하거나 긴 대화 세션이 필요한 경우 비용이 급증할 수 있으므로, 초기에는 제한된 범위에서 AI NPC를 도입하고 성공 사례를 바탕으로 점진적으로 확대하는 전략이 바람직하다. 게임 플랫폼 운영사는 여러 클라우드 서비스와 AI NPC 플랫폼을 혼합해 비용-성능 최적화와 서비스 안정성 확보에 나설 필요가 있다.

AI NPC 기술 도입을 위한 윤리적 가이드라인 수립과 단계적 접근

AI NPC 도입 과정에서는 기술적 과제뿐 아니라 윤리적 문제에 대한 대응도 중요하다. AI NPC가 플레이어와 대화를 나누면서 개인정보를 수집하거나 편향된 발언을 할 위험이 있으며, 특히 어린이와 청소년에게 미칠 영향을 신중하게 고려해야 한다. Ubisoft의 NEO NPC 프로젝트처럼 가드레일 시스템을 구축하고 인간 작가와 AI 간 협업 모델을 도입하는 것이 바람직하다. 작가가 캐릭터의 역사와 성격을 정의하고 AI가 그 가이드라인 내에서 대사를 생성하도록 설계함으로써 예측 불가능한 발언을 방지할 수 있다. 게임산업 협단체 차원에서 AI NPC 윤리 가이드라인을 수립하고, 콘텐츠 검열 시스템과 데이터 보호 정책을 마련하는 것이 필요하다.

앞서 언급했듯, 전문가들은 2026~2027년경 AAA 게임에서 AI NPC가 본격적으로 도입될 것으로 전망하고 있다. 한국 게임산업은 이 시점에 대비해 선제적으로 기술과 인력을 확보해야 한다. AI NPC 기술은 플레이어 경험을 혁신하고 새로운 게임 장르를 창출할 잠재력을 지니고 있다. 비선형적 스토리텔링, 개인화된 게임 경험, AI 동료 기반 샌드박스 게임 등 새로운 형태의 콘텐츠가 가능해진다. 장기적으로는 AI 동료 구독 서비스나 NPC 커스터마이징 유료 서비스 등 새로운 비즈니스 모델도 등장할 수 있다. AI 인프라 경쟁이 게임산업의 판도를 어떻게 바꿀지 지속적으로 모니터링하고 대응 전략을 수립하는 것이 중요해질 전망이다.

참고문헌

- OpenAI, "OpenAI and NVIDIA announce strategic partnership to deploy 10 gigawatts of NVIDIA systems", 2025.09.22, https://openai.com/index/openai-nvidia-systems-partnership/

- Reuters, "Nvidia to invest up to $100 billion in OpenAI, linking two artificial intelligence titans", 2025.09.22, https://www.reuters.com/business/nvidia-invest-100-billion-openai-2025-09-22/

- NVIDIA, "H200 GPU", Accessed 2025.12.03, https://www.nvidia.com/en-us/data-center/h200/

- Wccftech, "NVIDIA Blackwell GPU Architecture Official: 208 Billion Transistors, 5x AI Performance, 192 GB HBM3e Memory, 8 TB/s Bandwidth", 2024.03.18, https://wccftech.com/nvidia-blackwell-gpu-architecture-official-208-billion-transistors-5x-ai-performance-192-gb-hbm3e-memory/

- TechInsights, "Data-Center AI Chip Market – Q1 2024 Update", 2024.05.15, https://www.techinsights.com/blog/data-center-ai-chip-market-q1-2024-update

- Broadcom Inc., "OpenAI and Broadcom announce strategic collaboration to deploy 10 gigawatts of OpenAI-designed AI accelerators", 2025.10.15, https://investors.broadcom.com/news-releases/news-release-details/openai-and-broadcom-announce-strategic-collaboration-deploy-10

- AMD, "AMD and OpenAI Announce Strategic Partnership to Deploy 6 Gigawatts of AMD GPUs", 2025.10.06, https://ir.amd.com/news-events/press-releases/detail/1260/amd-and-openai-announce-strategic-partnership-to-deploy-6-gigawatts-of-amd-gpus

- AMD, "8-K - 10/06/2025", 2025.10.06, https://d1io3yog0oux5.cloudfront.net/amd/sec/0001193125-25-230895/0001193125-25-230895.pdf

- HotHardware, "AMD Instinct MI450 Is Coming In 2026 To Challenge NVIDIA's Vera Rubin, MI500 Arrives 2027", 2025.09.10, https://hothardware.com/news/instinct-mi400-challenge-vera-rubin

- Tom's Hardware, "AMD and Oracle partner to deploy 50,000 MI450 Instinct GPUs in new AI superclusters — massive capacity expansion powered by AMD's Helios rack architecture set for 2026", 2025.10.02, https://www.tomshardware.com/tech-industry/artificial-intelligence/amd-and-oracle-partner-to-deploy-50-000-mi450-instinct-gpus-in-new-ai-superclusters-deployment-of-expansion-set-for-2026-powered-by-amds-helios-rack

- Google, "Ironwood: The first Google TPU for the age of inference", 2025.11.07, https://blog.google/products/google-cloud/ironwood-tpu-age-of-inference/

- Tom's Hardware, "Google TPUs garner attention as AI chip alternative, but are only a minor threat to Nvidia's dominance — Alphabet's biggest challenge is widespread adoption", 2025.11.10, https://www.tomshardware.com/tech-industry/semiconductors/nvidia-responds-as-meta-explores-switch-to-google-tpus

- Intel, "Intel Gaudi 3 Expands Availability to Drive AI Innovation at Scale", 2024.04.09, https://newsroom.intel.com/artificial-intelligence/intel-gaudi-3-expands-availability-drive-ai-innovation-scale

- IoT Analytics, "The leading generative AI companies", Accessed 2025.12.03, https://iot-analytics.com/leading-generative-ai-companies/

- Hitmarker, "NVIDIA ACE for Games: AI-Driven NPCs Bring Virtual Characters to Life", 2024.01.08, https://hitmarker.net/news/nvidia-ace-for-games-ai-driven-npcs-bring-virtual-characters-to-life-522644

- 80.lv, "NVIDIA's Autonomous AI Characters Will Appear in Popular Games", 2024.05.28, https://80.lv/articles/nvidia-s-autonomous-ai-characters-are-coming-to-popular-games

- eesel AI, "What is Inworld AI? A deep dive for 2025", 2025.02.15, https://www.eesel.ai/blog/inworld-ai

- Ubisoft, "How Ubisoft’s New Generative AI Prototype Changes the Narrative for NPCs", 2023.03.21, https://news.ubisoft.com/en-us/article/5qXdxhshJBXoanFZApdG3L/how-ubisofts-new-generative-ai-prototype-changes-the-narrative-for-npcs

- Naavik, "AI NPCs: The Future of Game Characters", 2024.11.05, https://naavik.co/digest/ai-npcs-the-future-of-game-characters/

- Tripo AI, "Ultimate Guide - The Best AI NPC Generators of 2025", 2025.01.10, https://www.tripo3d.ai/content/en/use-case/the-best-ai-npc-generator

- PatentPC, "The AI Chip Market Explosion: Key Stats on Nvidia, AMD, and Intel’s AI Dominance", 2025.06.20, https://patentpc.com/blog/the-ai-chip-market-explosion-key-stats-on-nvidia-amd-and-intels-ai-dominance

- TrendForce, "[News] Google Unveils 7th-Gen TPU Ironwood with 9,216-Chip Superpod, Taking Aim at NVIDIA", 2025.11.07, https://www.trendforce.com/news/2025/11/07/news-google-unveils-7th-gen-tpu-ironwood-with-9216-chip-superpod-taking-aim-at-nvidia/